Виртуальная копия. Какие признаки позволят распознать дипфейк

Нейросети научились создавать цифрового двойника практически любого человека. Они могут подделывать не только внешность, но и голос

-

Белгородские известия

-

Белгородские известия

Как только технология стала доступна всем, её начали использовать и мошенники. В последнее время подобные истории всё чаще встречаются в новостных каналах. Речь идёт о людях, отдавших значительные денежные суммы злоумышленникам. Перед тем, как это сделать, они общались со своими родственниками, руководством, друзьями и не просто разговаривали, а видели их на экранах своих компьютеров, гаджетов, то есть были в полной уверенности, что общаются с хорошо знакомым им человеком. Но потом оказывалось, что реальные знакомые к ним не обращались, а в общении с ними мошенники использовали дипфейк.

Цифровой двойник

Со временем большинство наших сограждан всё‑таки научились не верить всей информации, что появляется в соцсетях. Но фейки-тексты с ложными сведениями заменила более передовая версия – дипфейки. Это реалистичная подмена фото, аудио и видеоматериалов, созданная искусственным интеллектом.

С помощью подделанного голоса или изображения злоумышленникам гораздо проще завоевать доверие человека и обмануть его. Людей под разными предлогами просят срочно перевести деньги на указанную банковскую карту, счёт или номер телефона. Работодатель, сотрудник государственных органов, известная личность из той сферы деятельности, в которой трудится будущая жертва мошенников, дают указание о переводе денежных средств, просят помочь в лечении болезни, расписывают ужасы дорожно-транспортного происшествия.

Окно в мир возможностей. Какие технологии используют в Валуйской центральной библиотеке

«Сегодня с помощью нейросетей достаточно просто сделать виртуальную копию голоса или изображения человека. Появились нейросети, которым хватает нескольких секунд видео или аудио со смартфона, чтобы создать цифрового двойника конкретного человека. Все эти данные получают в основном в результате взлома чужого аккаунта в социальных сетях или мессенджерах. И если ранее такая технология была доступна лишь специалистам, то теперь появились доступные приложения и боты, с помощью которых можно создать поддельное видео», – рассказывает специалист по информационной безопасности Алексей Боровинский.

Интернет-мошенники умеют в нужное видео вставить лицо определённого человека так, что подмену крайне трудно заподозрить. Таким же образом можно использовать и голос.

Один из самых популярных способов подобного мошенничества – голосом знакомого человека попросить деньги в долг. Раньше были распространены текстовые рассылки, но теперь уже мало кто в них верит, но как не помочь знакомому, когда ты видишь его лицо или слышишь голос.

Не наКЛИКай проблем. Почему цифровая безграмотность обходится дорого

Неестественная мимика

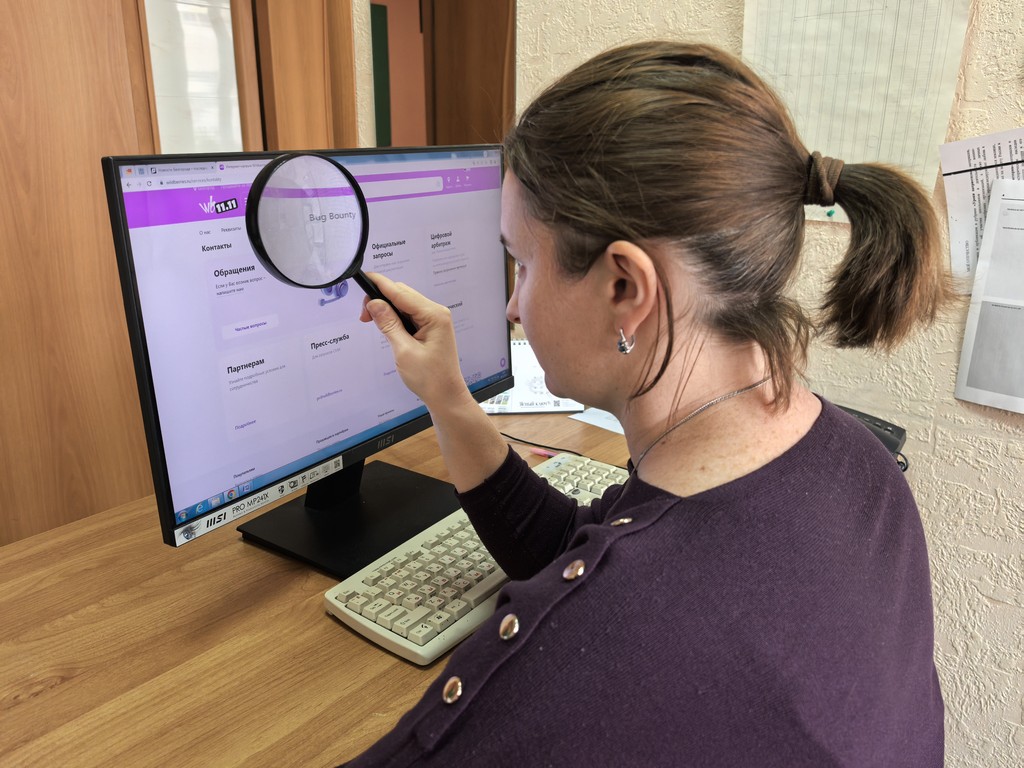

Как же поступить, чтобы не отдать мошенникам приличную денежную сумму, которую, как показывает практика, многие жертвы берут в кредит?

Первым делом нужно с недоверием отнестись к полученному от своего знакомого голосовому или видеосообщению с просьбой о помощи, ведь его аккаунт мог быть взломан. Поэтому сначала нужно удостовериться в правдивости информации, а для этого просто перезвоните тому человеку, от имени которого поступило сообщение. Если такой возможности нет, можно в сообщении задать сугубо личный вопрос, ответ на который знает только этот знакомый.

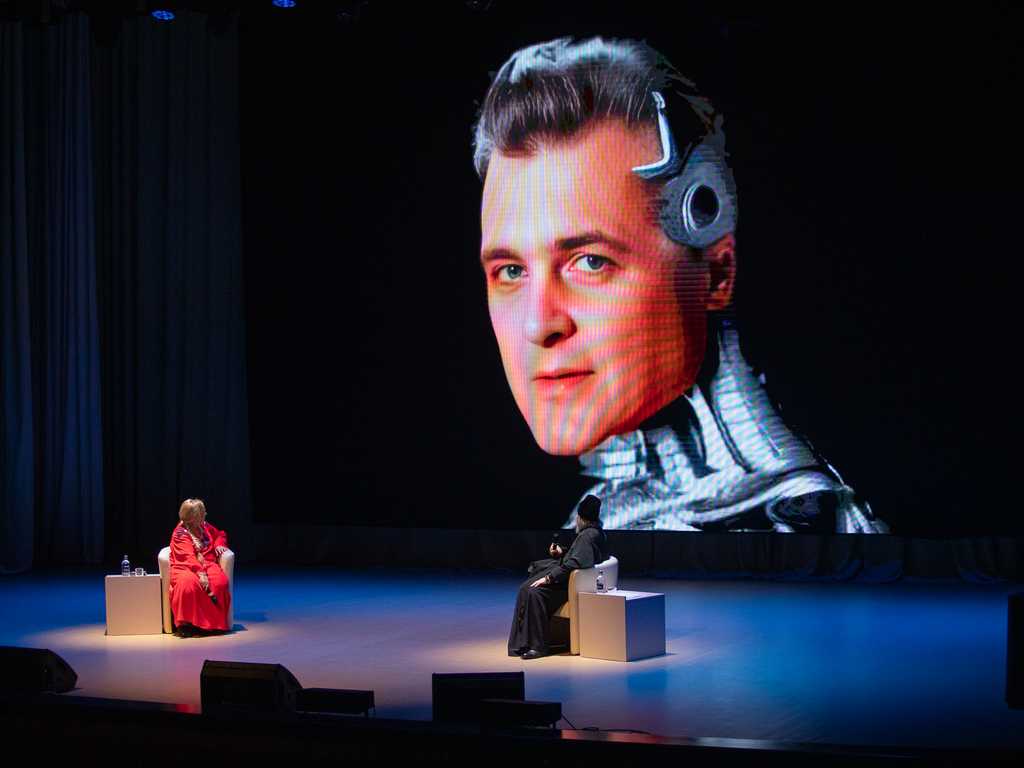

Если в некоторых солидных организациях есть технологии защиты, когда собственная нейросеть распознаёт чужую, то простому человеку остаётся только полагаться на собственную внимательность. Понять, что перед вами дипфейк, можно по неестественной мимике: человек медленно моргает, а движения губ не совпадают со словами, широко раскрывается рот, но при этом почти неподвижен подбородок. Но нейросети постоянно развиваются, изображение совершенствуется, поэтому нужно обращать внимание на более мелкие детали.

Не фантастика, а реальность. Нейросеть объяснила, может ли человек превратиться в робота

«Картинка может не напоминать натуральную, есть какие‑то прерывания, голос надламывается. Неестественно выглядят контуры, которые мошенники замыливают, ведь иначе будут видны неестественные края лица или неровный переход между лицом и фоном. Но при резких поворотах лица в разные стороны это может проявляться», – рассказывает Алексей Боровинский.

Должны насторожить несовпадающие элементы. Порой у дипфейков есть несоответствие между лицом и освещением, фоном, тенями, фокусом. Например, лицо кажется неестественно освещённым.

Привлечь внимание может и неправдоподобное поведение, когда на видео или аудио человек ведёт себя иначе, чем обычно, высказывает мысли, убеждения, ему несвойственные. Его речь кажется слишком правильной. Обычно люди нередко используют слова-паразиты, запинаются, в отличие от нейросетей, которые строят выверенные предложения. Но и у них есть пробелы: иногда звучат неверные ударения, у слов ненужная интонация, возникают неестественно длинные паузы. Кроме того, собеседник отвечает на уточняющие вопросы уклончиво, невнятно, согласно разработанному сценарию повторяет одну и ту же мысль для достижения поставленной цели.

Чтобы определить, не дипфейк ли перед вами, можно попросить человека встать, поправить волосы, снять очки. Если это на самом деле ваш знакомый, то он поймёт ваше беспокойство и правильно отреагирует на просьбу. У цифровой копии это сделать не получится, и она найдёт причины, чтобы отказать.

Нарушить закон

Можно ли привлечь человека к ответственности, если он использовал чужое изображение для дипфейка, например, взял отрывок из фильма и наложил ваше лицо на лицо героя с какой‑то определённой целью?

К сожалению, ни в одном законе ответственность за это пока не предусмотрена. Полиция занимается дипфейками, только если за этим последовало нарушение закона.

Но если ролик попал в сеть, то согласно закону о защите информации у каждого есть право обратиться к администрации соцсети и потребовать прекратить распространение недостоверных сведений. В течение десяти дней с момента получения требований ссылки на ложную информацию должны быть удалены.

Привлечь к ответственности за дипфейк можно, если его создатель будет шантажировать человека тем, что выложит видео в сеть, что является вымогательством. Если дипфейк распространяют, зная, что он не соответствует действительности, это будет являться клеветой. Ответственность в таком случае наступает, если автор дипфейка тайно делал фотографии для создания поддельного видео. Согласно закону сбор и использование любой информации о частной жизни возможны только после получения на это согласия.

Елена Мирошниченко